كتابة Melissa McNeilly في

أحد المبادئ التوجيهية لبرنامج التكتيكات الجديدة في حقوق الإنسان هو "التكيف الإبداعي". وهذا يعني أنه من أجل التقدم في مجال حقوق الإنسان، يجب علينا دفع حدود ما يمكن تحقيقه. لذلك برنامجنا يربط مدافعي حقوق الإنسان بحلول مبتكرة وقابلة للتكيف عن طريق استراتيجيات جديدة تعزز نشاطهم النضالي.

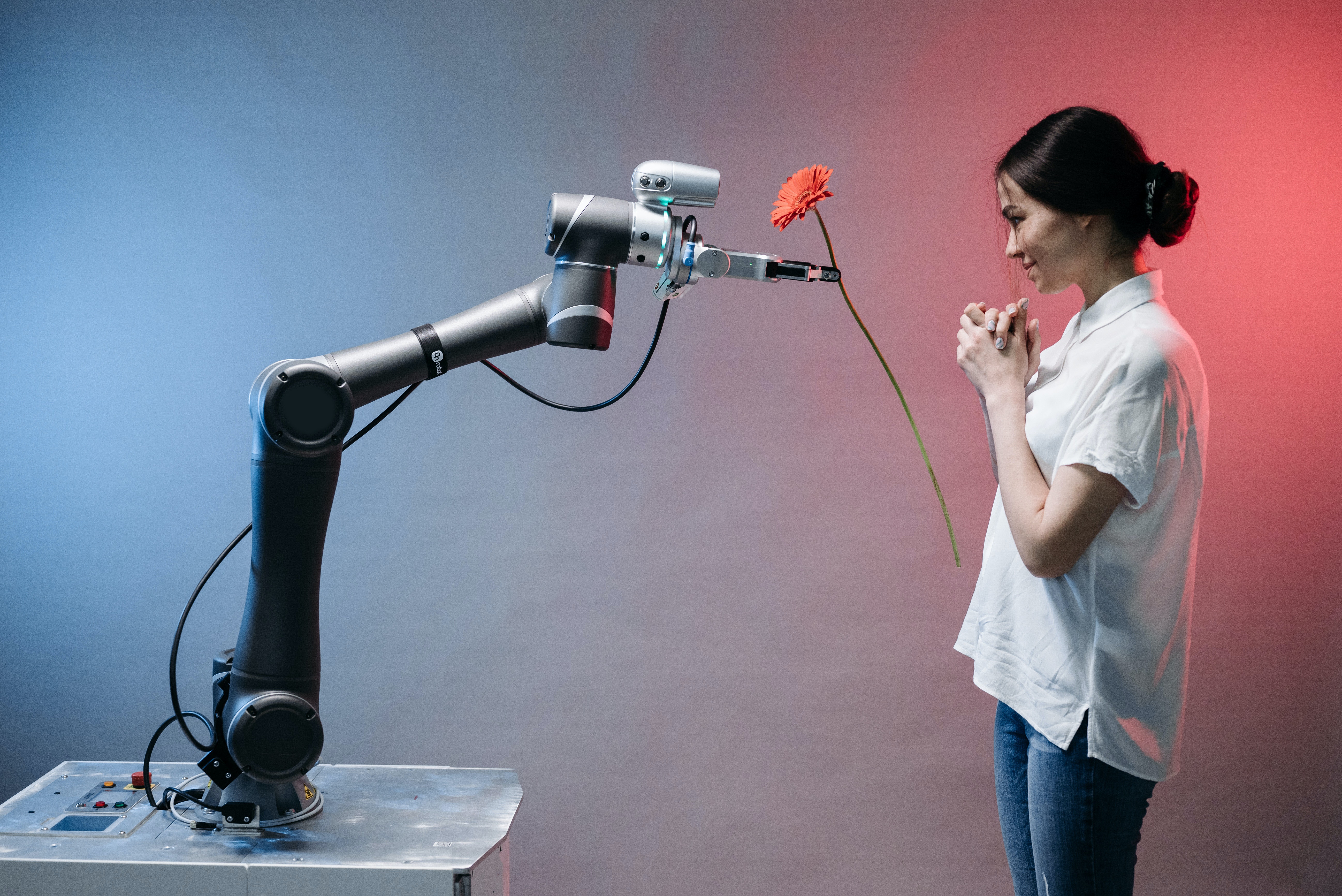

نحن ندرك أن التكنولوجيا لديها إمكانيات هائلة للتأثير على عالم حملات حقوق الإنسان. أدوات الذكاء الاصطناعي (AI) بكافة أشكالها لديها القدرة على تعزيز سير العمل الأكثر فعالية وتحسين تأثيرنا على حملات حقوق الإنسان. ومع ذلك، يجب أن نتخذ خطواتنا بحذر عند التعامل مع هذه الأدوات. من الأمور الأساسية التي يجب فهمها هي القضايا الأخلاقية المحيطة بإنشاء واستخدام أنظمة الذكاء الاصطناعي لضمان عدم انتهاك حقوق الإنسان. يحتوي الجزء الأول من هذه السلسلة، "مخاطر الذكاء الاصطناعي على حقوق الإنسان"، على مزيد من المعلومات حول هذا الموضوع.

يستكشف الجزء الثاني من هذه السلسلة استخدامات الذكاء الاصطناعي العملية الأخرى في مجال حملات حقوق الإنسان، مسلطًا الضوء على الفوائد المحتملة والعيوب.

كيف يمكن للذكاء الاصطناعي تعزيز مبادرات حقوق الإنسان

لقد كانت المنظمات غير الحكومية والقواعد الشعبية ومنظمات المجتمع المدني والمؤسسات غير الربحية دائمًا في طليعة النضال من أجل العدالة وحقوق الإنسان. قد بدأ بعضنا، من الذين يعملون لصالح هذه الجهات، في تجربة تقنيات مثل "تشات جي بي تي" في حياتهم الشخصية والمهنية. ففي ميدان يعاني من قلة الوقت والموارد قد تكون هناك طرق لاستخدام الذكاء الاصطناعي (AI) لتعزيز جهودنا في الحفاظ على حقوق الإنسان. يمكن للنشطاء ومدافعي حقوق الإنسان استخدام الذكاء الاصطناعي (AI) على النحو التالي:

- استخدام الذكاء الاصطناعي في التواصل الاستراتيجي

الوقت هو مورد لا يمكن لمدافعي حقوق الإنسان أن يحصلوا عليه بما فيه الكفاية. لذا، قد تكون التقنيات الذكية قادرة على إنشاء الأفكار في لمحة بصر، مما يوفر الوقت والمال ويسرع عجلة التغيرات في المجتمع. وهذا يجعلها أداة قوية للتواصل الاستراتيجي في حملات المدافعة.

عادة ما تشمل حملات حقوق الإنسان يمطالبات للحصول على دعم من أشخاص قد تكون لديهم معتقدات وتجارب حياة مختلفة تمامًا عنا كعاملين في المنظمات. على سبيل المثال، كيف يمكن لحملة مدافعة في مجال العدالة المناخية أن تقنع شخصًا لا يؤمن بتغير المناخ واعتماد العلاقة بين حقوق الإنسان والعمل البيئي؟ إن استخدام هندسة التوجيه الذكي (AI prompt engineering) من الممكن أن يحسّن الحملة وصياغتها لتصل للفئات المستهدفة بشكل أكبر وأكثر فعالية.

إذًا، ما هي هندسة التوجيه الذكي (AI prompt engineering) بالتحديد؟ إنها الطريقة التي يتفاعل فيها المستخدم مع تقنية مثل ChatGPT، حيث يقدم لها توجيهات دقيقة وسياقًا محددًا لتوجيهها نحو الإجابة المرغوبة. عادةً ما ستحصل على نتائج أفضل إذا كان استفسارك أكثر وضوحًا. وللحصول على أفضل النتائج من برنامج مثل ChatGPT، قم بتصميم استفسارك على النحو التالي:

-

حدد اللهجة التي ترغب أن تجيب بها الأداة. على سبيل المثال، يمكن أن يُطلب من ChatGPT التحدث بلطف للتعبير عن التعاطف مع الصعوبات التي يواجهها المنتهك حقهم. ويمكن إلهام القراء لدعم الحملة عند استخدام اللهجة العاجلة والضرورية والتي تكون ذات منحى عملي. وعلى صعيد عرض الحقائق والمعلومات يكون ذلك بتوجيهه باستخدام لهجة تعليمية لزيادة فهم مشكلة ما.

-

حدد مستوى القراءة التي ترغب في أن يكون نصك عليه. قد يكون من المفيد للنشطاء وحقوق الإنسان توضيح الأفكار الصعبة لجعلها سهلة الفهم. على سبيل المثال، يمكننا أن نطلب من ChatGPT تطوير اقتراحات سياسية وتفسير اللغة القانونية لضمان أفضل قابلية للقراء من مختلف الفئات.

-

حدد عمق وطول النص الذي تريده. من المفيد تضمين التنسيق المطلوب لرسالتك. ربما تقوم بصياغة نص لمنشور على وسائل التواصل الاجتماعي أو مقال رأي أو بيان صحفي. غالبًا ما تكون المساحة في هذه الأنواع من الاتصالات محدودة، لذا فإن التعريف الدقيق للمعايير أو عدد الكلمات لمخرجات الذكاء الاصطناعي يمكن أن يوفر الوقت والجهد في موازنة نوعية وكمية المعلومات المتضمنة.

-

ادمج الفروق الثقافية واللغوية. تختلف قضايا حقوق الإنسان بشكل كبير بين الثقافات والمناطق. وكما نعلم، يمكن أن تعمل أدوات الذكاء الاصطناعي على تعزيز وتضخيم التحيزات. لذلك، قد يكون من المفيد تحديد كيف يمكن للأداة أن تجعل النص مناسبًا لجمهور معين. على سبيل المثال، يمكنك توجيه ChatGPT لتقديم قصة أو مثال يكون ذا صلة للجمهور في أمريكا اللاتينية أو الشرق الأوسط. ولا يمكننا منع عدم الحساسية فقط بإدراج هذه التفاصيل في المدخلات، يمكننا جعل رسائل حملتنا أكثر ارتباطًا وتأثيرًا. بالاضافة الى ذلك، فإن أدوات الترجمة التحريرية والترجمة الشفوية التي تعمل بالذكاء الاصطناعي تكسر الحواجز اللغوية، مما يمكّن المدافعين عن حقوق الإنسان من التواصل مع مختلف السكان وتبادل رسائلهم حول العالم.

تحذير! حتى عندما نعطي سياقًا محددًا من الضروري الحذر وإجراء تحرير دقيق للغاية لتحسين النتائج التي ينتجها الذكاء الاصطناعي. أدوات مثل ChatGPT دقيقة حتى آخر بيانات التحديث الخاصة بهم، وهذا يعني أن الأداة قد تقدم معلومات قد تكون مضللة بشكل مراوغ أو غير دقيقة من الناحية الواقعية. على سبيل المثال، قد لا يعرف ChatGPT من فاز بكأس العالم للسيدات لعام 2023 إذا كان آخر تحديث له ببيانات سبتمبر 2021. لذلك، نحث جميع من في قطاعات حقوق الإنسان على التحقق من صحة أي معلومات مشاركة، تمامًا كما يجب علينا فعله مع أي مصدر آخر.

واحدة من مبادئ التكتيكات الجديدة الرئيسية هو "عدم التسبب بالأذى". فمن أجل حماية أنفسنا وزملائنا والأشخاص المعرضين للخطر من أي أذى محتمل، يجب على النشطاء أن يكونوا حذرين عند إدخال البيانات في مدخلات الذكاء الاصطناعي. لذلك نحث المدافعين عن حقوق الإنسان على الأخذ بعين الاعتبار ما قاله الخبراء مثل ميريديث ويتاكر، رئيسة شركة Signal : الذكاء الاصطناعي نفسه هو أداة للرصد. بخلاف استخدامه لإعادة تدريب خوارزميات الذكاء الاصطناعي، ليس من الواضح ما يحدث مع البيانات المدخلة، لذا، يجب على نشطاء حقوق الإنسان توخي الحذر عند إدخال البيانات على "تشات جي بي تي" بعدم تضمين أي معلومات شخصية أو بيانات حساسة. في هذه المرحلة، مع استمرار ظهور التكنولوجيا، لا يوجد تنظيم و/أو شفافية كافية لضمان التزام النشر العام بالمعايير الأخلاقية الدنيا التي حددتها اللائحة العامة لحماية البيانات وقانون الاتحاد الأوروبي للذكاء الاصطناعي.

- استخدام الذكاء الاصطناعي لتحسين سير العمل: أتمتة المهام المتكررة

يمكن للأتمتة التي يحركها الذكاء الاصطناعي تبسيط المهام الإدارية واللوجستية، وتمكين النشطاء من تخصيص المزيد من الوقت والطاقة للتخطيط الاستراتيجي والتكتيكي، أو الراحة والإبداع. فيما يلي بعض الأمثلة على كيفية قيام منصات الذكاء الاصطناعي بأتمتة المهام المتكررة في أعمال حقوق الإنسان:

- الذكاء الاصطناعي لتوليد ردود البريد الإلكتروني: Compose AI هو عنصر يضاف لـGmail يمكنه صياغة الرسائل مباشرة في تطبيق البريد الإلكتروني الخاص بك. يمكنك استخدام نفس النصائح الموضحة أعلاه لتوليد أفضل رسالة. من خلال استخدام أداة مثل هذه، يمكن لنشطاء حقوق الإنسان الاستجابة بسرعة لمهام أكثر رتابة وروتينية، وتوفير الوقت لممارسات المرونة أو العمل الإبداعي.

- الذكاء الاصطناعي لاستيعاب النص الطويل: عندما يكون الوقت محدودًا للقراءة والبحث، يمكن للذكاء الاصطناعي في ChatGPT أن يعيد صياغة المقالات أو إعادة صياغة المحتوى لجعله أكثر وضوحًا. إضافة Gimme Summary لمتصفح Google Chrome، هي أداة مجانية، بإمكانها تلخيص المقالات تلقائيًا. ويمكن لـ ChatPDF.com استخراج المعلومات من الملفات PDF التي تقوم بتحميلها (دليل، كتب، مقالات)، مما يمكنك من تعديل أي ملف PDF يصل إلى 120 صفحة.

- الذكاء الاصطناعي لإدارة المشاريع: يمكن أن يقترح ChatGPT أجندة تدريبية وجداول زمنية وخرائط عمليات وميزانيات وأدوات تخطيط وغيرها والتي يمكن استخدامها كنقطة انطلاق للمشاريع أو الفعاليات.Show Me Diagrams التابع لـ ChatGPT بإمكانه تحويل عملية كتابية إلى تصور عملي. على سبيل المثال، يمكن أن تطلب منه بـ "إنشاء تصور لعملية تخطيط حملتي."

- الذكاء الاصطناعي لإنشاء العروض التقديمية: إضافة SlidesAI.io لـ Google Slides ستحول أي نص تقدمه إلى شرائح جميلة، بمجموعة مختلفة من الأنماط والألوان. مرة أخرى، مثل هذه التقنيات يمكن أن توفر وقتًا كبيرًا للنشطاء ومدافعي حقوق الإنسان يمكنهم استخدامه في جوانب أخرى حيوية من عملهم. هناك برامج مماثلة أخرى متاحة لبرامج PowerPoint والشرائح.

- الذكاء الاصطناعي للاستنساخ الصوتي: هناك العديد من التطبيقات التي تقوم بأتمتة تقنيات نسخ الصوت أو الفيديو مثل Otter وWhisper.. يمكن أن توفر هذه الوقت في نسخ مقاطع الفيديو أو البودكاست وتساعدك على جعل المحتوى الخاص بك أكثر سهولة في مجموعة متنوعة من الأشكال.

- روبوتات دردشة الذكاء الاصطناعي كنقطة اتصال أولى: يمكن للروبوتات التفاعل مع الداعمين والجهات المعنية، والرد على الأسئلة الشائعة والرد على الاستفسارات الأولية. قد تتيح مثل هذه الابتكارات للمنظمات ذات الموارد المحدودة مجالاً أكثر فعالية مع المتطوعين والممولين. على سبيل المثال، يدرب برمجة روبوت للدردشة للرد على أسئلة شائعة مثل "كيف يمكنني التبرع؟" أو "أرغب في التطوع" من خلال توجيه المستخدم إلى الصفحة أو النموذج الصحيح. مما يعطي ذلك المجال للموظفين للتعامل مع أسئلة أكثر تعقيدًا.

ليست هناك الكثير من المهام التي لا يوجد أداة ذكاء اصطناعي لها. من الضروري أن تختار كل منظمة تعتمد على حقوق الإنسان استراتيجية خاصة بها لاستخدام الذكاء الاصطناعي في عملها. وفي الرابط مثالًا على سياسة من Code Hope Labs يمكن أن تكون مفيدة للمنظمات التي تجري نقاش استخدام الذكاء الاصطناعي.

نصيحتنا: أن يبقى الإنسان متطلعًا في جميع الأوقات. بدلاً من إنشاء عمليات تعتمد بالكامل على تكنولوجيا غير موثوقة، قم باستخدام هذه التقنيات بذكاء لتوفير وقتك حتى يمكنك اتخاذ إجراء تكتيكي عاجل أكثر.

يجب على المستخدمين ممارسة الحذر لتجنب الاعتماد المفرط على هذا النوع من التقنيات. يمكن أن تجعل مشكلات الوصول أسوأ في يوم من الأيام من خلال أدوات مثل ChatGPT التي تختبئ وراء جدران الدفع. الإصدار المجاني يؤدي أداء متوسط على الأكثر، والذي لا يقارن بالمعرفة والخبرة الواسعة لمدافعي ونشطاء حقوق الإنسان.

- استخدام الذكاء الاصطناعي كتكتيك ساخر سياسي

مع استمرار قدرات الذكاء الاصطناعي في التطور، تتزايد إمكانية ظهور أنواع أكثر تعقيدًا وابتكارًا من السخرية السياسية. فيمكن لاستخدام الفكاهة أو السخرية أو المحاكاة الساخرة أن يعزز الخطاب النقدي حول عبثية وعواقب القرارات السياسية.

كمثال على السخرية التي تم إنشاؤها بواسطة الذكاء الاصطناعي قامت مجموعة بإنشاء حالات محاكاة حيث تم تصوير قادة العالم على أنهم لاجئين أو عمال منخفضي الأجور. هذه الاستراتيجية مثيرة بالتأكيد للجدل، لكنها فعالة في جذب انتباه الجمهور وإلقاء الضوء على السياسات التي تؤذي الأقليات.

سويلا برافرمان، سياسية بريطانية تم تصويرها كلاجئة في صورة تم إنشاؤها بواسطة الذكاء الاصطناعي تهدف إلى انتقاد سياسات الهجرة القاسية التي تتبعها

لطالما كان اندماج الفكاهة والاحتجاج حافزًا للتغيير الاجتماعي. السؤال هو ما إذا كان يمكن أن يكون الذكاء الاصطناعي بمثابة تكتيك جديد ومبتكر لإثارة الخطاب النقدي - أو ما إذا كان ينبغي تجنب إنشاء صور «التزييف العميق» تمامًا. مرة أخرى، نوصي بأن تحدد كل منظمة أو حملة فردية ما إذا كانت فوائد هذا التكتيك تفوق المخاطر في ظروفك الخاصة بالحملة، وتحديد التوقعات للعمل التكتيكي المسؤول.

استخدام الذكاء الاصطناعي في العمل في مجال حقوق الإنسان: قصة تحذيرية

استخدم العاملون في المجال الإنساني والتنموي منذ فترة طويلة التكنولوجيا الجديدة لتوثيق الانتهاكات ومساعدة الأشخاص المحتاجين. سواء كان ذلك باستخدام الهواتف المحمولة لتسجيل فيديوهات تساعد على توثيق حالات العنف أو الطائرات بدون طيار ودراسة صور الأقمار الصناعية لتقدير حجم الكوارث الطبيعية من بعيد، لا يمكننا إنكار أن الابتكار التقني قد قدم تحسينات في الطرق التي نعمل بها. ومع ذلك، فإن طبيعة هذه التكنولوجيا وقدرتها على جمع وتحليل البيانات تتطور بسرعة. يمكن للذكاء الاصطناعي معالجة البيانات بسرعة هائلة، مستخرجًا أنماطًا وتحليلات معنوية يستغرق البشر وقتًا طويلاً بالنسبة لهم لاكتشافها. يمكن لنشطاء حقوق الانسان استغلال الذكاء الاصطناعي لتحليل انتهاكات حقوق الإنسان، وتتبع الظلم المجتمعي، وتحديد التمييز الممنهج، مما يوفر لهم أساسًا قويًا لحملاتهم.

على الرغم من إثارة إمكانيات هذه الأدوات، فمن المهم أيضًا أن ندرك أننا لا نعرف بعد كل الأضرار والمخاطر المحتملة. كيف يمكننا تحقيق التوازن بين الفوائد الإيجابية لهذه التكنولوجيا الجديدة والمخاطر المحتملة؟

"ليس من الواضح ما إذا كانت نفس التكنولوجيات التي تقلب مختلف جوانب حياتنا الاقتصادية والاجتماعية لها أيضًا الإمكانية لمعالجة معاناة البشر وتمكينهم وتحقيق العدالة." - مارك لاتونيرو وزارا رحمان، البيانات وحقوق الإنسان والأمن الإنساني .

مع انتشار المزيد والمزيد من أدوات الذكاء الاصطناعي في البرامج التي نستخدمها يوميًا مثل Google وMicrosoft وAdobe، يصبح من الأهمية أن نتعلم كيف ندمج هذه الأدوات بحكمة وفقط عندما يكون مناسبًا. قد تعتمد بعض حملات حقوق الإنسان بشكل كبير على الذكاء الاصطناعي، في حين قد تقرر منظمات أخرى أو نشطاء فرديون أن استخدام الذكاء الاصطناعي غير مشجع على الإطلاق. على الرغم من أن الفوائد المحتملة للذكاء الاصطناعي في الحملات الحقوقية مفيد جداً، إلا أنه من المهم أن يستخدم نشطاء ومدافعو حقوق الإنسان من هذه التكنولوجيات بحذر، وأن يأخذوا الوقت لفهم قدراتها وقيودها والمخاطر المحتملة.

للمزيد من الموارد حول الذكاء الاصطناعي في حقوق الإنسان، تفضل بالاطلاع على أعمال Witness، و Social Movement Technologies، ومعهد البحث في الذكاء الاصطناعي الموزع (DAIR)، بالإضافة إلى المقالات المدرجة أدناه.

المصادر:

The AI and Campaigning Handbook, Campaign Lab

Witness: Using Generative AI for Human Rights Advocacy (2023)

AI Governance and Human Rights

Human rights by design - future-proofing human rights protection in the era of AI (2023)

Unboxing artificial intelligence: 10 steps to protect human rights (2019)

(UN) Regulation essential to curb AI for surveillance, disinformation: rights experts (2023)

- دخولتسجيل الدخول أو إنشاء حساب جديد للتعليق.